所有數據,都蘊含 AI 潛力

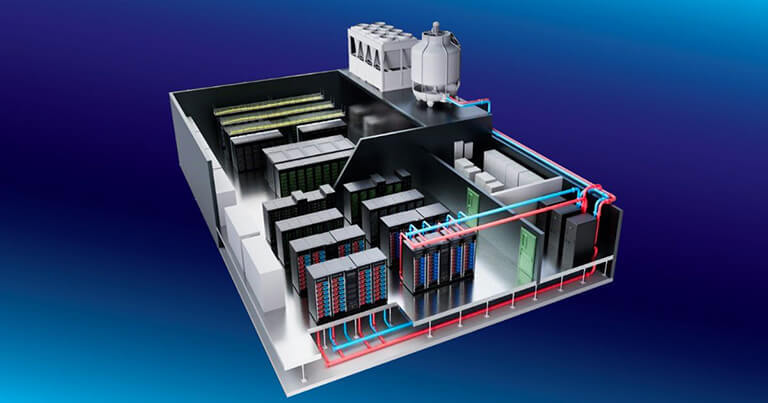

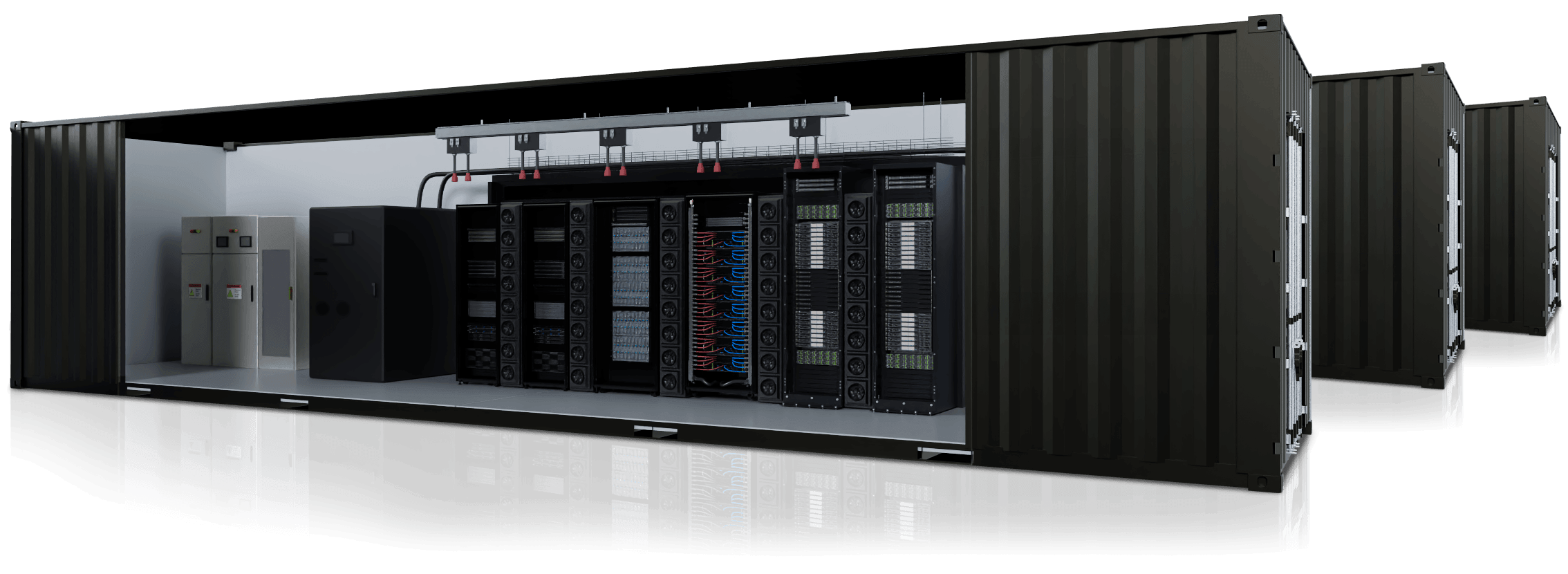

AI 工廠 (AI factory) 是專為組織量身打造的專業級 AI 基礎建設,能將大數據改造成潛力無窮的 AI 發明,增強組織競爭力或開創新財源。技嘉是 AI 解決方案與資料中心基礎建設服務供應商,致力於幫助客戶打造專屬的 AI 工廠,吻合使用需求的軟硬體組合能將既有的 IT 架構升級成為智慧成長引擎。而立足台灣,由技嘉設計建造的 GIGABYTE AI Factory Accelerator (GAIFA),則可加速系統測試、驗證與部署流程,協助全球客戶順利導入 AI 工廠架構。歡迎聯繫技嘉,創造你的 AI 工廠!

·

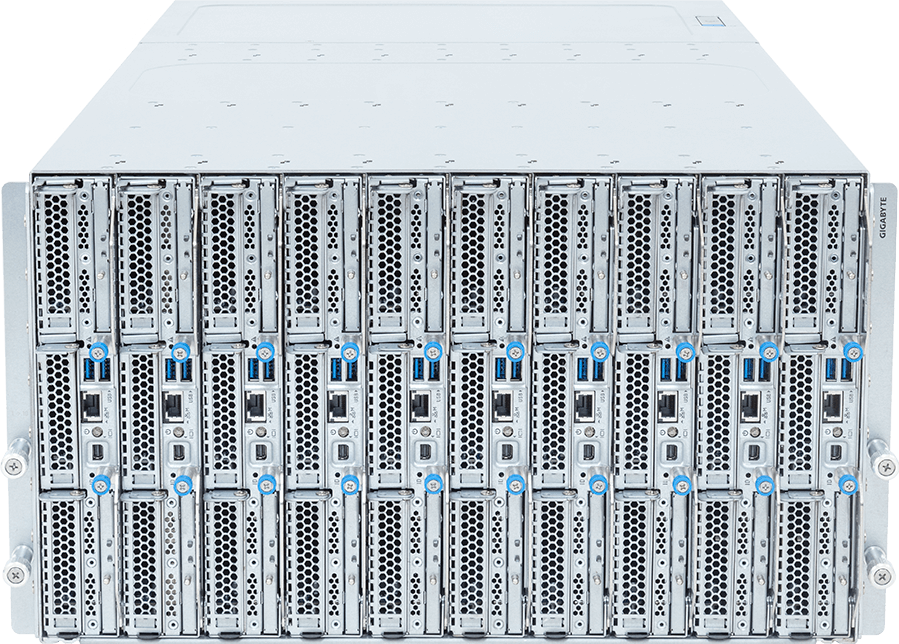

主掌 GIGAPOD,激發你的人工智慧成長潛能

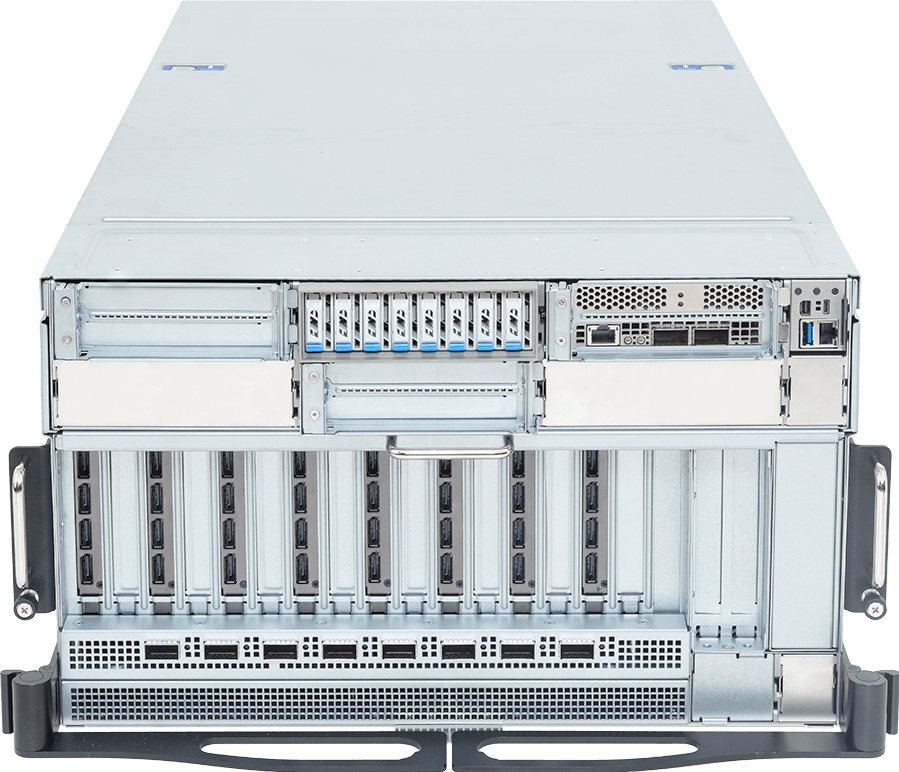

AI 工廠的算力來自高可擴充性的超算叢集,利用專為深度學習與 AI 訓練所設計的晶片將大數據轉變成 AI 詞元 (token),用其開創新型 AI 工具。技嘉的 GIGAPOD 解決方案採用極速通訊互聯技術,將大量的 GPU 加速器連結形成統一單位的強大運算叢集,實現規模化平行運算,發揮突破性的 AI 效能。技嘉推出多選擇性的硬體配置,用戶可挑選 AMD Instinct™、Intel® Gaudi® 或 NVIDIA HGX™ 運算模組,亦可搭配氣冷或液冷方案,達到超乎預期的效率與投報率。GIGAPOD 搭載技嘉 GPU 協同運算伺服器和中央控管伺服器,追加整合冷卻液、電源分配裝置的中介管理技術 G-REX,以及提供資料中心基礎建設管理 (DCIM) 和工作負載排程等多項加值服務的全堆疊軟體套件 GPM。客戶亦可導入以機櫃級電力架構為核心的 GIGAPOD Rack Scale 產品組合,驅動 AI 運算基礎架構的全面升級。

氣冷配置直接液體冷卻配置

*運算機櫃數量 + 管理機櫃數量

| 支援 GPU | 伺服器高度 | 每機櫃功耗 | 每 SU 機櫃數量* | 每機櫃 PDU |

|---|---|---|---|---|

| NVIDIA HGX™ B300 | 8U | 70 kW / 66 kW | 8 + 2 / 8 + 1 | 8 x 63A / 4 x 63A |

| NVIDIA HGX™ B200 | 8U / 8OU | 70 kW / 54 kW | 8 + 1 | 8 x 63A / 4 x 63A |

| NVIDIA HGX™ H200 | 8U | 58 kW | 8 + 1 | 4 x 63A |

| NVIDIA RTX PRO™ 6000 Blackwell Edition | 4U | 80 kW | 4 + 1 | 4 x 63A |

| AMD Instinct™ MI350 Series | 8U | 70 kW | 8 + 1 | 4 x 63A |

| AMD Instinct™ MI300 Series | 5U / 8U | 50kW - 100kW | 4 + 1 / 8 + 1 | 2 x 100A / 4 x 63A |

| Intel® Gaudi® 3 | 8U | 62kW | 8 + 1 | 4 x 63A |

·

NVIDIA Vera Rubin: 專為 AI 推理時代而生

進入 AI 代理與推理時代,企業需採用高可擴充性的 AI 運算平台,加速處理參數規模劇增的 AI 模型開發需求。技嘉推薦使用 NVIDIA Vera Rubin NVL72 及 Rubin NVL8 解決方案,透過高吞吐資料傳輸結合專為 AI 而生的先進處理器,全力推進智慧推理、自主決策能力與可擴展 AI 基礎架構的部署。

NVIDIA Vera Rubin NVL72 機櫃級產品,整合 36 顆 Vera CPU 及 72 顆 Rubin GPU,並結合 NVIDIA ConnectX®-9 SuperNIC™、BlueField®-4 DPU 與 NVIDIA NVLink™ 6 交換器,讓 AI 模型在大規模應用中更快產出結果;Rubin NVL8 則運用 400 petaFLOPS 推論效能及 160TB/s 高頻寬記憶體進行運算,實現推理型 AI 的應用落地,兩者皆是 AI 工廠的首推產品。

NVIDIA Vera Rubin NVL72 機櫃級產品,整合 36 顆 Vera CPU 及 72 顆 Rubin GPU,並結合 NVIDIA ConnectX®-9 SuperNIC™、BlueField®-4 DPU 與 NVIDIA NVLink™ 6 交換器,讓 AI 模型在大規模應用中更快產出結果;Rubin NVL8 則運用 400 petaFLOPS 推論效能及 160TB/s 高頻寬記憶體進行運算,實現推理型 AI 的應用落地,兩者皆是 AI 工廠的首推產品。

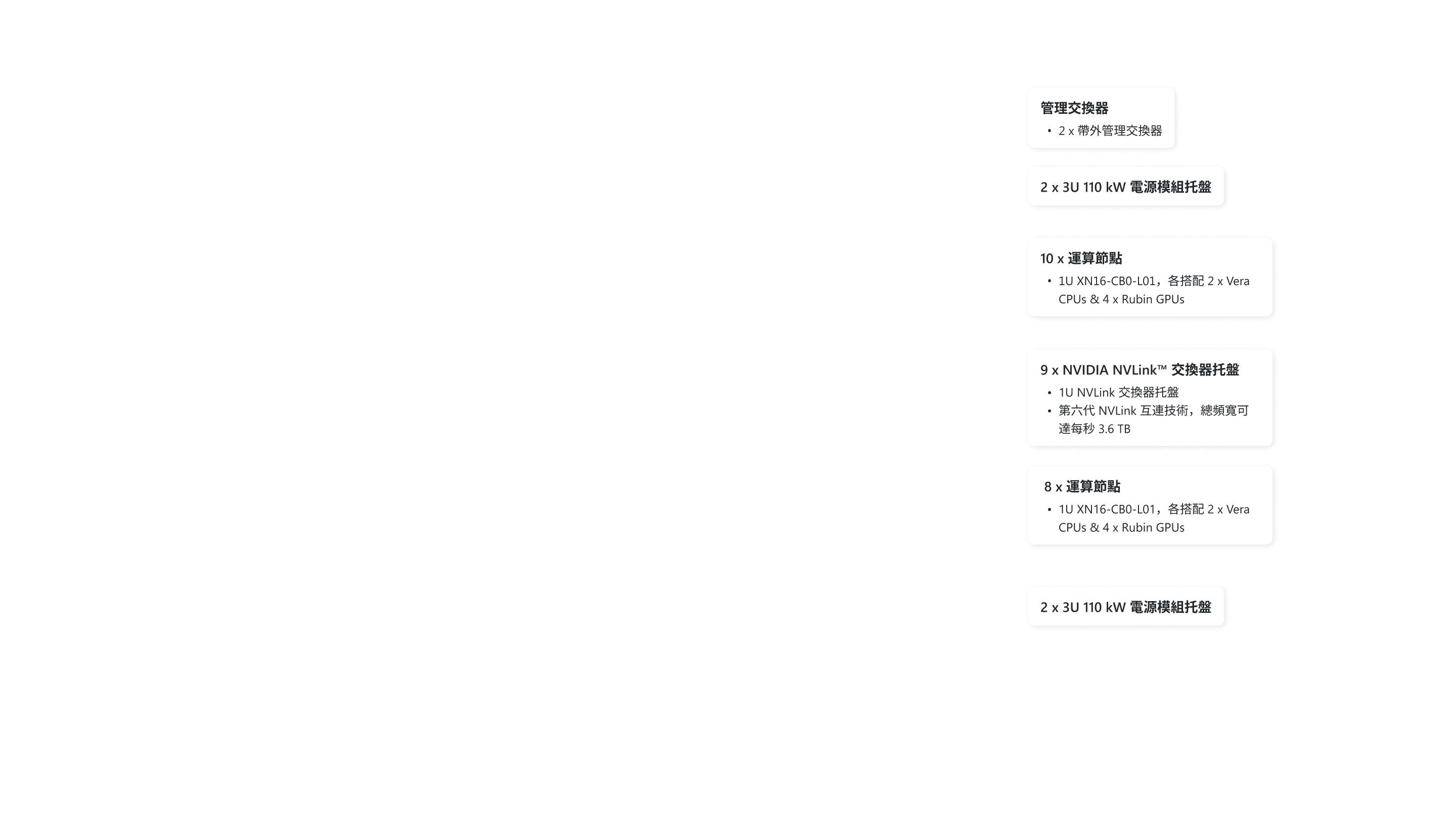

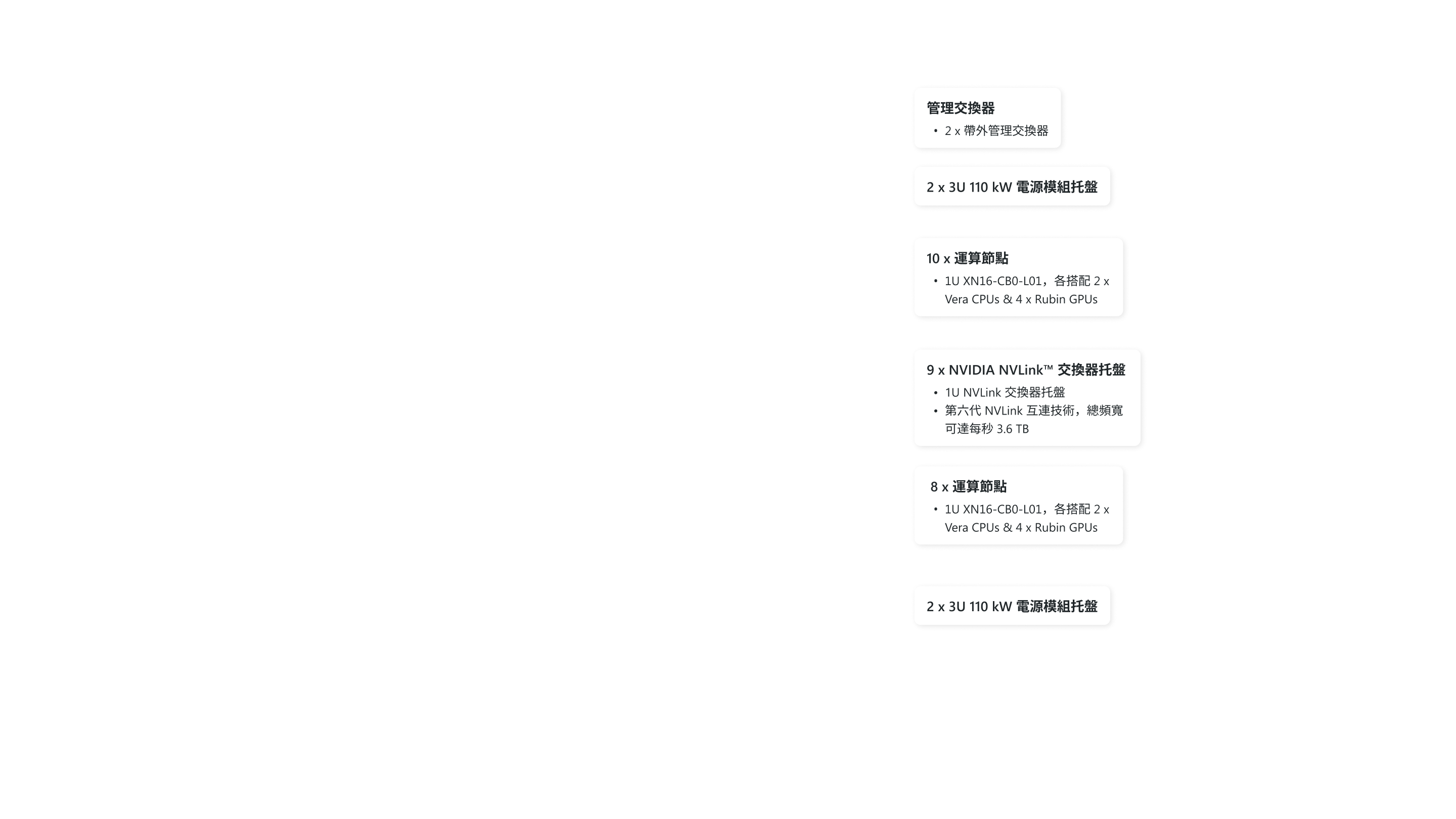

1 管理交換器

- 2 x 帶外管理交換器

2 2 x 3U 110 kW 電源模組托盤

3 10 x 運算節點

- 1U XN16-CB0-L01,各搭配 2 x Vera CPUs & 4 x Rubin GPUs

4 9 x NVIDIA NVLink™ 交換器

- 1U NVLink 交換器托盤

- 第六代 NVLink 互連技術,總頻寬可達每秒 3.6 TB

5 8 x 運算節點

- 1U XN16-CB0-L01,各搭配 2 x Vera CPUs & 4 x Rubin GPUs

6 2 x 3U 110 kW 電源模組托盤

7 相容於 in-row 冷卻液分配器

NVIDIA GB300 NVL72:專為 AI 推理時代而生

運用大數據完成 AI 模型訓練之後的下一階段,就是利用 AI 模型開創嶄新的智慧工具,部署於組織內部或是對外銷售。AI 產品的用戶數量非常龐大,須採用高可擴充性的 AI 推論平台才能同時服務眾多使用者,推薦購入 NVIDIA GB300 NVL72 機櫃級解決方案,運用全液冷設計將 72 顆 NVIDIA Blackwell Ultra GPU 與 36 顆 Arm® 架構的 NVIDIA Grace™ CPU 整合於單一平台,專為測試階段推論擴展 (test-time scaling inference) 而優化。在 AI 工廠部署上,NVIDIA GB300 NVL72 搭配 NVIDIA Quantum-X800 InfiniBand 或 Spectrum™-X Ethernet,並結合 NVIDIA ConnectX®-8 SuperNIC™,可端出比 NVIDIA Hopper™ 平台高出 50 倍的推論效能,讓 AI 模型在大規模應用中更快產出結果,實現生成式 AI 與智慧應用的落地。

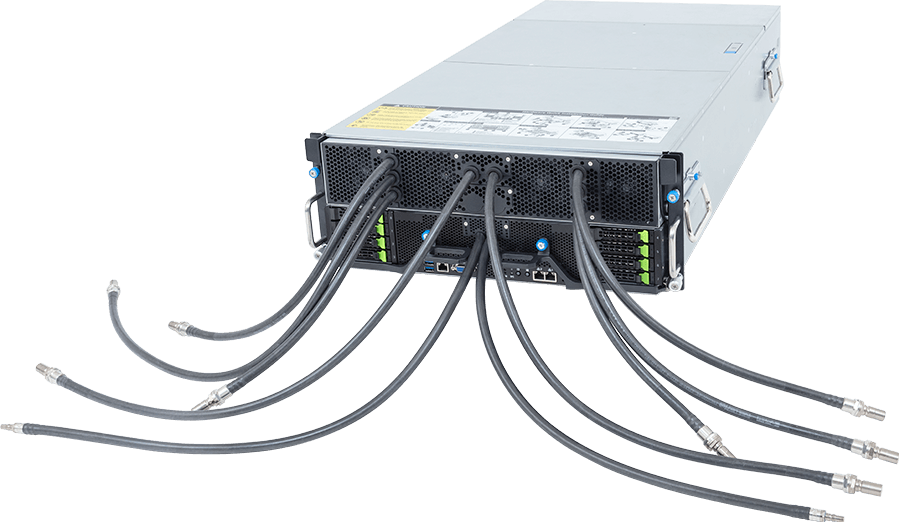

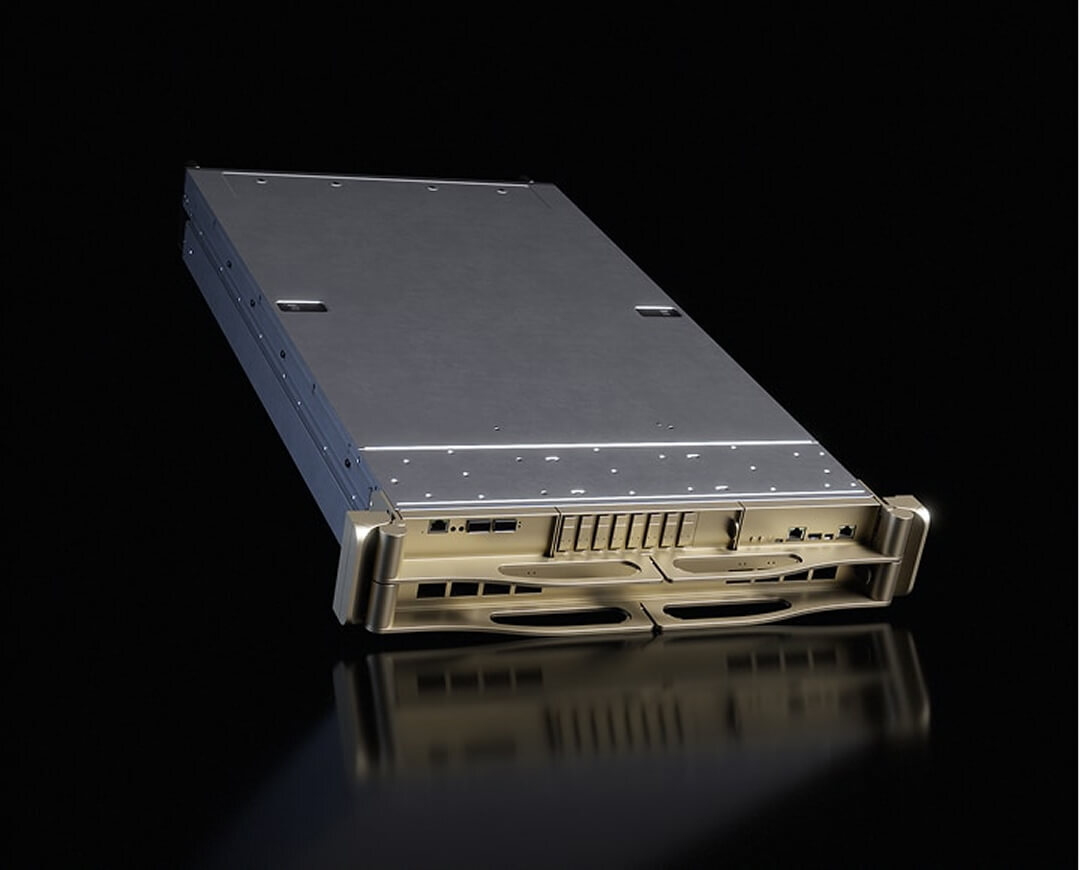

NVIDIA Rubin NVL8

| GPU | 8x NVIDIA Rubin GPUs |

| GPU 記憶體總計 | 頻寬 | 2.3 TB | 160 TB/s |

| CPU | 2x Intel® Xeon® 6 處理器 |

| NVIDIA NVLink 交換器系統 | 4倍 |

| NVIDIA NVLink 頻寬 | 總頻寬達每秒 28.8 TB/s |

| 網路 | 8x OSFP 連接埠,可連接 8 個單連接埠 NVIDIA ConnectX®-9 VPI - 高達每秒 800 Gb 的 NVIDIA InfiniBand 和乙太網路 2x 400G QSP112 NVIDIA BlueField®-4 DPUs - 高達每秒 800 Gb 的 NVIDIA InfiniBand 和乙太網路 |

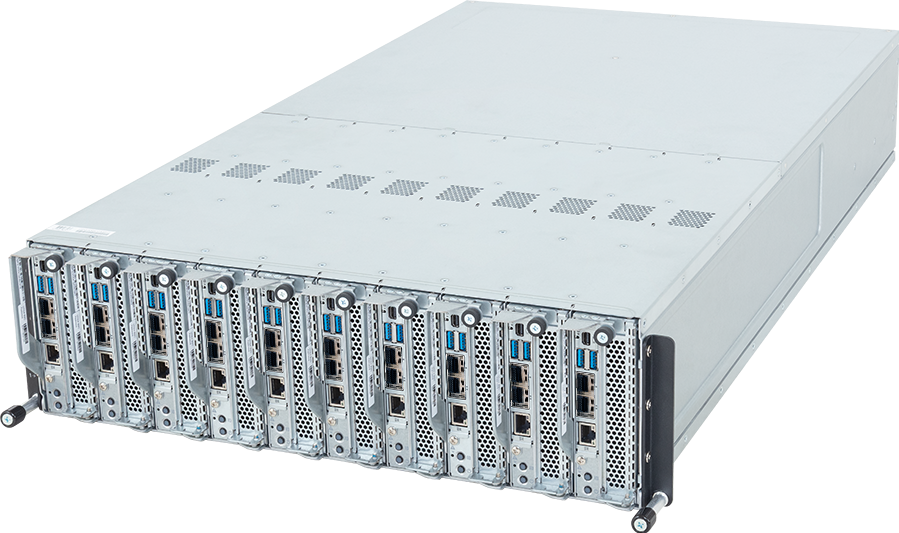

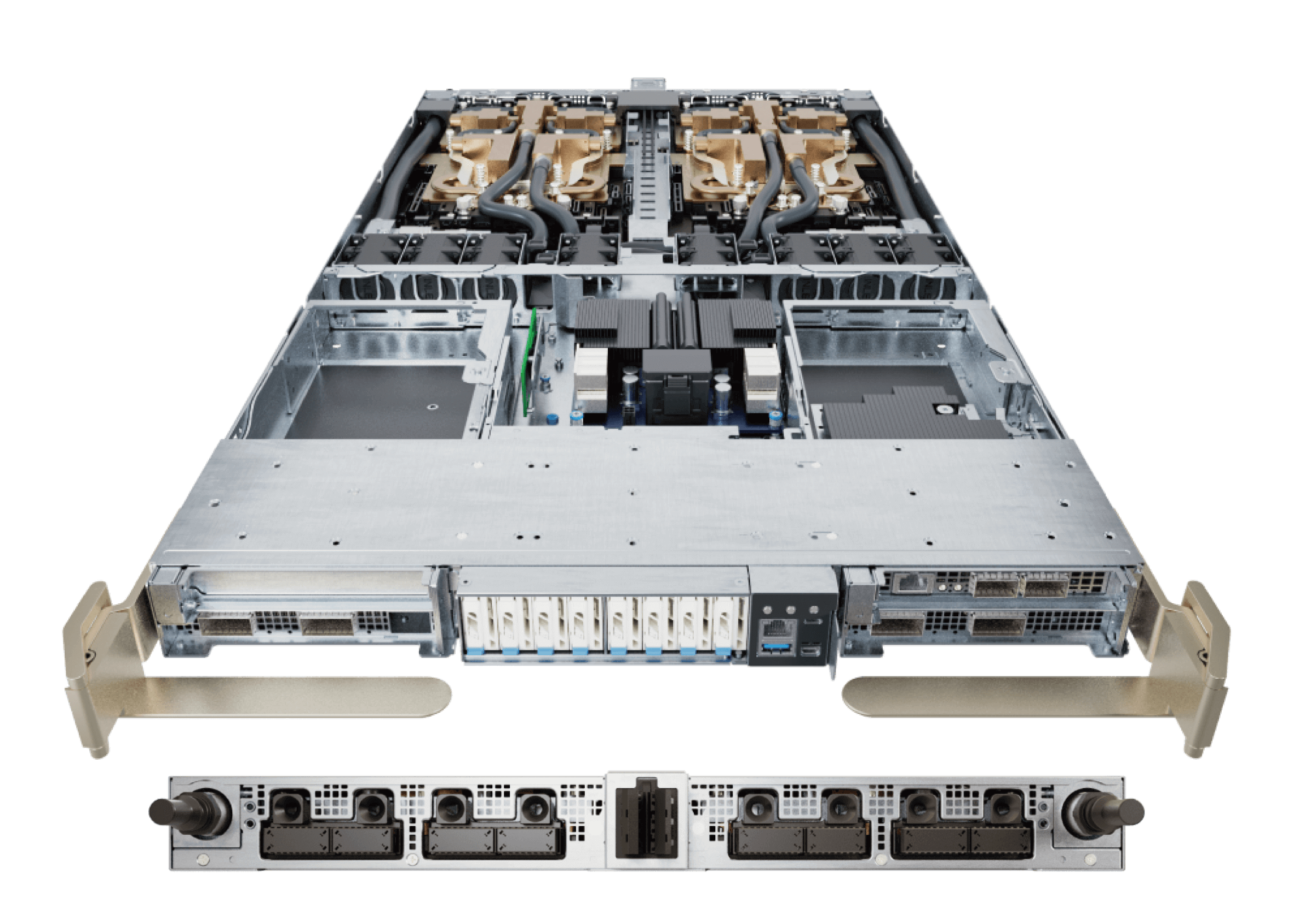

XL44-SX2-AAS1 with RTX PRO™ 6000 Blackwell Server Edition GPUs

- NVIDIA RTX PRO™ 伺服器搭載 ConnectX®-8 SuperNIC 交換器

- 搭載 8 張 NVIDIA RTX PRO™ 6000 Blackwell 伺服器版本 GPU

- 搭載 1 張 NVIDIA BlueField®-3 DPU

- 板載 400Gb/s InfiniBand/Ethernet QSFP 埠搭配 PCIe Gen6 交換器,實現 GPU 對 GPU 最高效能

- 雙 Intel® Xeon® 6700/6500 系列處理器

- 8-通道 DDR5 RDIMM/MRDIMM, 32 x DIMMs

- 2 x 10Gb/s 網路埠 (Intel® X710-AT2)

- 8 x 2.5" Gen5 NVMe 熱插拔硬碟槽

- 2 x M.2 插槽 (PCIe Gen4 x2)

- 3+1 3200W 80 PLUS 鈦金級冗餘電源供應器